在 Astra 上运行 Llamafile

LLM 的限制

LLM 是功能强大的工具,有许多用途,但输出可能包含不准确、偏见或安全问题。

简介

顾名思义,LLM 是大型模型。Meta Llama 3.2 主要面向云服务,有 700 亿参数,但也发布了能力降低的较小模型版本 - 10 亿参数版本可以在 4GB RAM 的设备(如 Synaptics Astra SL1680)上舒适运行。

信息

本快速指南适用于所有 SL16xx 开发板。虽然推理性能可能有所不同,但在所有 Astra SL 系列处理器上的步骤都是相同的。

Llamafile

运行 Llama 3.2 1B 的快速方法是使用 Mozilla 基金会的 Llamafile。Llamafile 简化了 LLM 的运行,将其作为单个二进制文件,减少了设置复杂性。让我们现在尝试一个示例!

首先,我们必须将模型下载到开发板上(注意这是一个 1.2GB 的下载):

wget https://huggingface.co/Mozilla/Llama-3.2-1B-Instruct-llamafile/resolve/main/Llama-3.2-1B-Instruct.Q6_K.llamafile

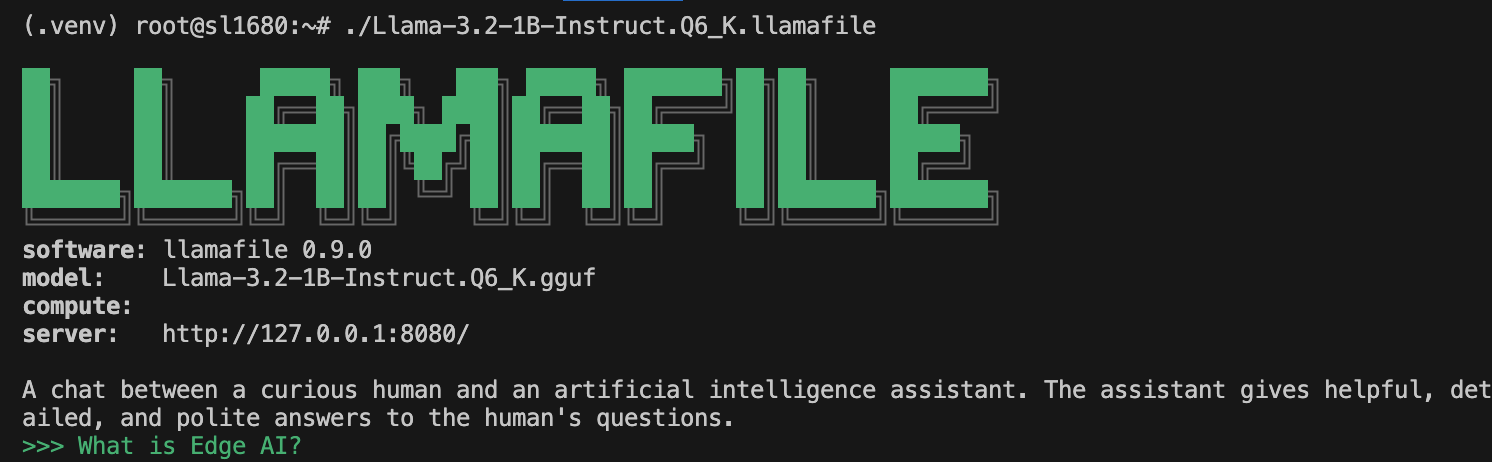

接下来,我们将运行 Llama 3.2 LLM:

chmod +x Llama-3.2-1B-Instruct.Q6_K.llamafile

./Llama-3.2-1B-Instruct.Q6_K.llamafile

当您看到提示符时,您可以提出问题并按 return 键查看 LLM 生成的响应:

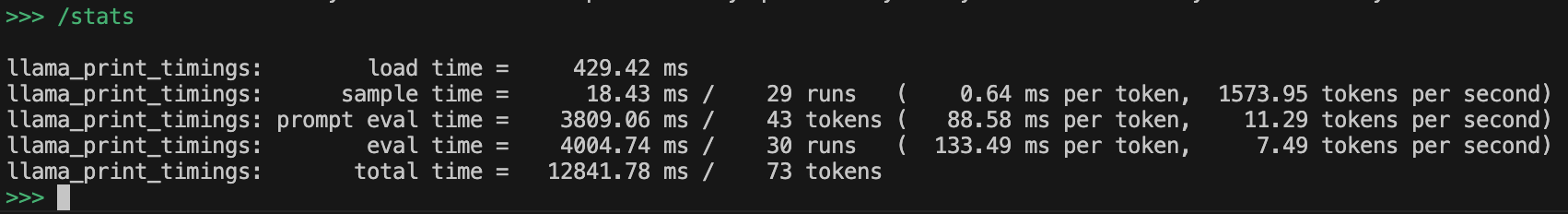

您可以输入命令 /stats 来获取 LLM 的一些性能统计信息:

按 CTRL + C 退出 llamafile。